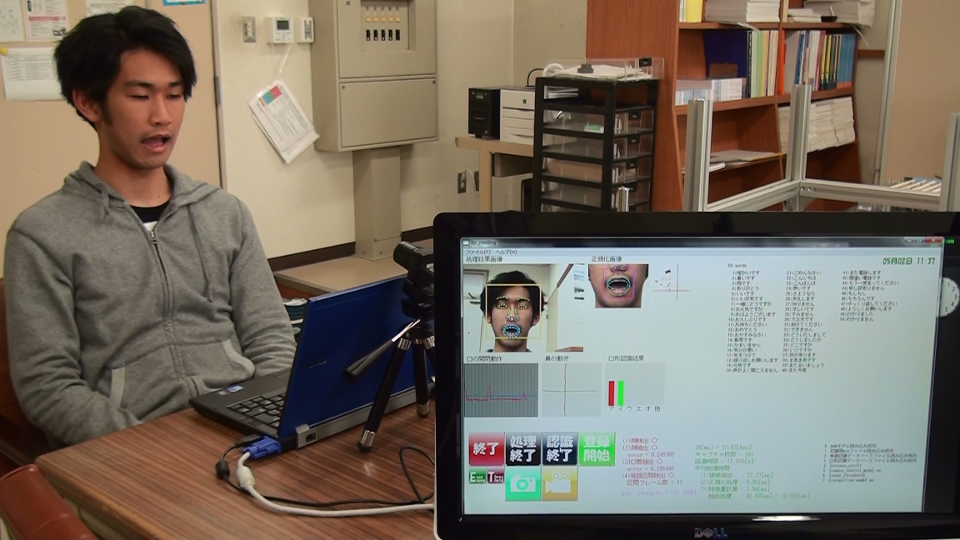

視覚情報のみから発話内容を理解する読唇技術:齊藤剛史 准教授

人は発話内容を認知するとき、音声情報だけでなく、口形や表情などの視覚情報を利用しています。

高齢者や障害者には音声コミュニケーションが困難な人がいます。そこで、音声情報を用いずに視覚情報のみから発話内容を理解する読唇に関する基礎研究および、読唇技術を利用したコミュニケーション支援システムの開発に取り組んでいます。

仕組み

- ビデオカメラなどで撮影された「おはよう」「ありがとう」などの日常会話の発話映像から、画像処理技術を用いて人の顔、さらに目、鼻、口などの部位を検出します。

- 口周辺の画像より口の動きを捉えて発話内容を認識します。

- カメラは非接触センサであり、また音声情報を用いないため、高騒音環境や音声を含まない映像に対しても適用可能なメリットがあります。

キーワード

画像処理、パターン認識、ヒューマンインタフェース、読唇、音声・聴覚・言語障害の補助手段

研究者

九州工業大学 情報工学研究院

知能情報工学研究系

齊藤剛史(Takeshi Saitoh)

博士(工学)。豊橋技術科学大学大学院工学研究科 電子・情報工学専攻修了。鳥取大学工学部電気電子工学科助教などを経て平成22年4月より九州工業大学大学院情報工学研究院システム創成情報工学研究系准教授。平成26年9から平成27年1月までフィンランドオウル大学CMV客員研究員。視覚情報のみから発話内容を理解する読唇技術を中心とした顔画像処理、手話認識などに関する研究に取り組んでいる。

Webサイト:http://www.slab.ces.kyutech.ac.jp/

読唇技術に関するシステム『クチヨミ』